荣格工业资源APP

了解工业圈,从荣格工业资源APP开始。

因人工智能(AI)芯片算力大战而引发的技术竞逐战中,CPU(中央处理器)+GPU(图形处理器)异构计算形式的存算一体芯片备受瞩目。

最近一次有关存算一体芯片供货消息,来自英伟达的GPU H200。3月28日,据日本经济新闻报道,英伟达的GPU H200现已开始供货。根据英伟达方面公布的性能评测结果,以Meta公司旗下大语言模型Llama 2处理速度为例,H200相比于H100,生成式AI导出答案的处理速度最高提高了45%。

但作为全球首款CPU+GPU异构计算形式的存算一体芯片,AMD推出的Instinct MI300系列比之GPU H200提前了3个月交付。1月23日《科创板日报》讯,AMD首批Instinct MI300X已开始向客户交付。已知的AMD Instinct MI300系列客户包括Meta、谷歌、微软等巨头,而Lamini AI则是首家公开使用MI300X的公司。

而无论是AMD还是英伟达,要实现存算一体芯片的CPU+GPU异构计算形式都使用了Chiplet技术。这,是否会成为Chiplet搭乘AI芯片风口的最好机会?

用异构计算拓宽AI应用领域赛道

异构计算主要是指使用不同类型指令集和体系架构的计算单元组成系统的计算方式。常见的计算单元类别包括CPU、GPU、DSP、ASIC、FPGA等。目前“CPU+GPU”正是备受业界关注的异构计算平台之一。

CPU+GPU异构计算是一种将中央处理器和图形处理器集成在一起的技术,通过各自的优势,提高处理速度和能效比。在传统架构中,CPU负责执行程序的逻辑运算,而GPU则主要负责图形渲染。除了各自的功用不同,一个很大的区别在于:CPU可单独作用,处理复杂的逻辑运算和不同的数据类型,但当需要处理大量类型统一的数据时,则可调用GPU进行并行计算。但GPU无法单独工作,必须由CPU进行控制调用才能工作。

异构计算技术使得两者可以共享数据并进行协同计算,从而加速了机器学习、科学计算等并行计算密集型任务的运行效率。随着CPU与GPU的结合,这个“1+1”模式可以解决深度学习模型训练在CPU上耗时长的问题,提升深度学习模型的训练效率。同时,也为AI芯片衍生的高性能、高质量、高速率算力需求难题提供新的技术创新。因为,在异构计算环境中,AI芯片可以与其他类型的计算资源(如CPU、GPU、DSP等)协同工作,共同完成复杂的AI任务。

事实上,包括英特尔、英伟达、高通等巨头都在押注异构计算,并希望借此拓宽自己在AI芯片的赛道。

比如英特尔提出的“超异构计算”概念,在一定程度上可以理解为通过封装技术所实现的模块级系统集成,即通过先进封装技术将多个Chiplet装配到一个封装模块当中,既简化了SOC的复杂技术,更加灵活,又避免了PCB板级集成的性能和功耗瓶颈。

3月初,高通公司发布《通过NPU和异构计算开启终端侧生成式AI》报告。报告认为,异构计算能够实现最佳应用性能、能效和电池续航,以最大化发挥生成式AI终端用户体验。NPU专为实现以低功耗加速AI推理而全新打造,其架构随着新AI算法、模型和用例的发展不断演进。

高通Hexagon NPU面向以低功耗实现持续稳定的高性能AI推理而设计,差异化优势在于系统级解决方案、定制设计和快速创新。通过定制设计NPU并控制指令集架构(ISA),高通能够快速进行设计演进和扩展,以解决瓶颈问题并优化性能。

因此,随着AI算法的复杂度和对算力的需求的不断增长,异构计算和AI芯片的结合变得尤为重要。异构计算技术确保了计算任务能够分配到最合适的计算资源上,而AI芯片则为这些计算任务提供了高度优化的处理能力,使得整个系统的性能得到了提升。

性能对比看Chiplet的用武之地

那么,使用chiplet技术是否会让芯片设计者、制造商们更易于实现芯片的商用和落地呢?先来具体看看英伟达的GPU H200和AMD Instinct MI300系列:

英伟达GPU H200

英伟达的GPU H200基于Hopper架构开发,专为处理大规模生成式AI和高性能计算(HPC)工作负载而设计的。通过NVIDIA NVLink和NVSwitch高速互连支持,可实现高效的计算性能和数据传输。它还兼容此前的GH200 Grace Hopper超级芯片,并可通过HGX平台提供不同的配置选项,以满足不同规模和需求的AI应用。

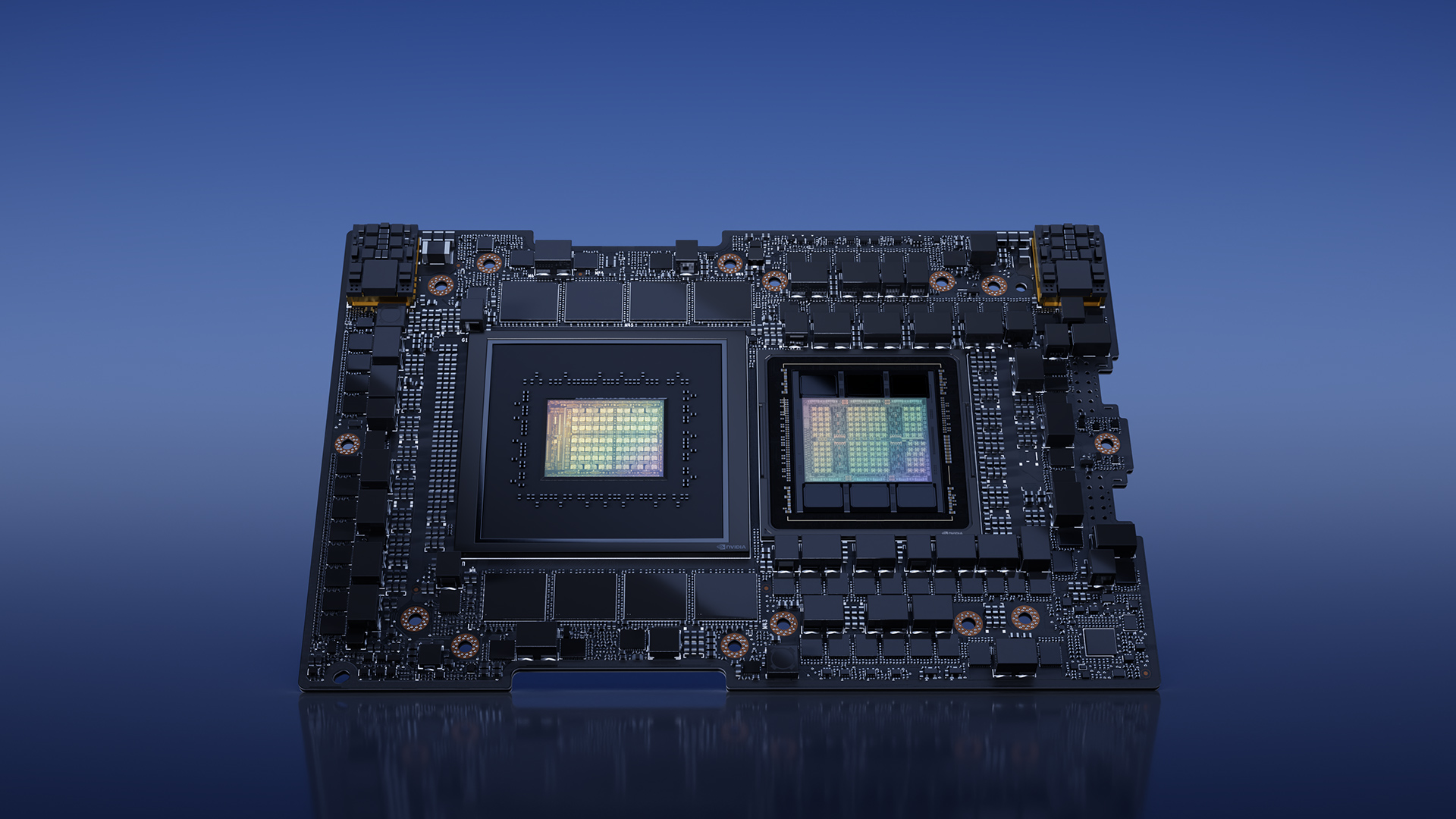

图:NVIDIA GH200 Grace Hopper 超级芯片 ®(图片来源:英伟达)

值得注意的是,英伟达在H200中使用了台积电的CoWoS 2.5D封装技术,这是chiplet技术的一种实现方式。而且有报道指出,英伟达可能在H200之后开始使用chiplet,将GPU模块化成块,在一个封装中可以选择CPU、加速器和互连,各个模块可以使用不同工艺制造。这表明英伟达在H200的后续产品线中计划采用更加灵活的芯片设计策略,通过模块化的方式来提升性能和效率。

使用chiplet技术意味着H200可以利用不同的制程技术来整合不同的功能模块,这在以往是难以实现的。这种设计允许英伟达在保持高性能的同时,还能降低制造成本和复杂性。

AMD Instinct MI300系列

该系列主要包括两款产品:MI300A和MI300X。MI300A是一款集成了CPU和GPU的APU产品。它包含了24个Zen 4 CPU核心和一个CDNA 3图形引擎,内存容量高达128GB HBM3。

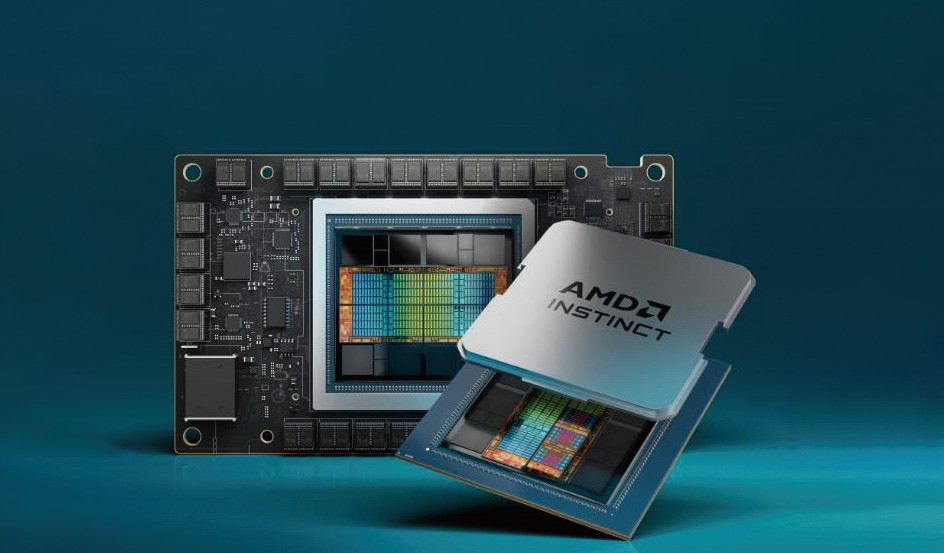

图:AMD Instinct MI300 系列(图片来源:AMD)

MI300A内部拥有多达13个5/6nm小芯片(CPU/GPU计算核心为5nm,HBM内存和I/O等为6nm),其中使用了大量的3D堆叠技术,以便创建一个面积可控的单芯片封装,总共集成1460亿个晶体管。

MI300X则是一款纯GPU设计的加速器产品。它封装了12个不同的芯粒,包括8个5nm工艺的GPU和多个6nm工艺的I/O芯粒。内存容量达到了惊人的192GB,内存带宽为5.2TB/s,InfinityFabric带宽为896GB/s。

值得注意的是,该系列也采用了台积电SolC(3D)和CoWos(2.5D)两种封装技术。这种设计使得AMD Instinct MI300系列具有更高的性能和更好的能效比。比如相比于之前的MI250,MI300A可以提供超过8倍的性能和5倍的处理效率。

尽管目前Chiplet技术还面临依赖于先进的封装技术、互连接口与协议、质量控制、测试难度和成本大等系列挑战,但英伟达GPU H200和AMD Instinct MI300系列的顺利交付,至少表明,Chiplet技术已经成为推动异构计算发展的重要力量,反之,随着应用端及技术的不断演进,其也将受益于异构计算在AI芯片市场中的机会而水涨船高。

来源:荣格-《智能制造纵横》

原创声明:

本站所有原创内容未经允许,禁止任何网站、微信公众号等平台等机构转载、摘抄,否则荣格工业传媒保留追责权利。任何此前未经允许,已经转载本站原创文章的平台,请立即删除相关文章。