荣格工业资源APP

了解工业圈,从荣格工业资源APP开始。

在将创新疗法推向市场的竞赛中,制药业正在不断寻找改进其药物发现、开发和交付的过程。今年话题最热的,当然是大型语言模型(large language models,LLM),其中就包括ChatGPT,重新激发了各行业围绕人工智能(AI)及其对现有工作流程的潜在变革的讨论。

尽管讨论很多,但人工智能的应用,是否能够,或者说能在哪些领域真正颠覆行业,还有待观察。固有的技术限制,与火热的技术还尚未没有达到其炒作能力水平,ChatGPT等工具将给制药业带来的影响究竟有多少?

在这篇文章中,我们将讨论LLM在制药业内的多种应用和功能领域所能带来的范式转变,并观察LLM与全面的生命科学数据集、精心设计的知识图谱,以及针对制药业的培训模型和专家监督等面向结合起来所能产生的变革性潜力。

LLM的发展历程

LLM的历史可以追溯到20世纪50年代和60年代的人工智能研究的早期。然而,直到最近,随着计算能力和数据可用性的大幅度进步,LLM才变得实用而备受关注。通过对大量文本数据的训练,这些模型产生了对人类语言模式和结构的理解,使得ChatGPT(及其衍生产品)之类的LLM能够与用户进行自然语言对话。

与其他聊天机器人不同的是,ChatGPT仅限于预先编程的回应,它可以参与对话,回答问题,并产生新的想法,其水平往往与人类对话无异。凭借其用户友好的界面,用户可以与ChatGPT互动,而不需要任何事先的技术知识,只需像任何人对另一个人一样对它「说话」。

LLM能做什么?

1. 医学智能

LLM工具的搜索和查询临床数据和试验结果的能力,能帮助制药公司及时了解其领域的最新进展。工具模型可以创建与研究设计、临床结果和统计结果有关的紧凑、简洁的关键信息摘要,使利益相关者能够快速了解试验的最重要方面。反过来,这些情报可以用来为药物开发提供信息,确定潜在的研究领域,并监测正在进行的临床试验的进展。

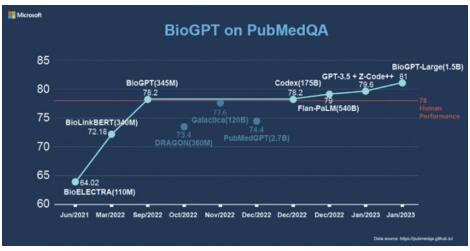

分析大量的科学文献,对精力和时间科研人员来说是一大挑战。为了解决这个问题,微软公司开发了一款名为BioGPT的人工智能系统,它基于ChatGPT的模型,接受过PubMed网站上超过1500万篇摘要的训练,可以根据用户的提问迅速提供相关的答案。在PubMedQA检中,这款人工智能模型达到了81.0%的准确性,这使得它成为了一个非常有用的工具,帮助科研人员更快地了解最新的科学研究进展。

BioGPT的工作原理是通过对PubMed上的海量的摘要进行训练,建一个强大的自然语言处理模型,使其能够识别和理解科学文献中的术语和概念,并根据用户的提问提供相关的答案。这使得科研人员可以更快地找到他们需要的信息,从而更快地跟上科学研究的步伐。

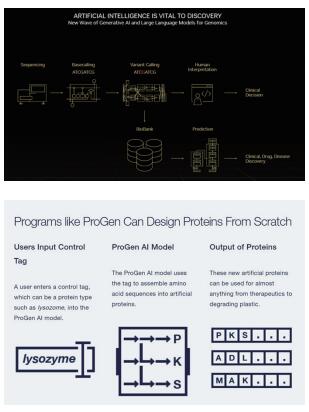

而新一代基因组测序技术的不断发展,也带来更快速、更便宜地测序基因组DNA的能力,但分析这些海量的基因组数据仍然是巨大的挑战。针对这一点,NVIDIA在今年的JP摩根医疗健康大会上指出,LLM,如ChatGPT,可以被于解读基因组DNA序列,从而加快基因组的拼接、基因突变的发现,并且用人类对话的方式将现表述给研究人员。

通过像分析人类语言一样分析DNA序列,LLM可以识别和理解基因组数据中的术语和概念,并根据用户的提问提供相关的答案。这种方法使科研人员更快地找到他们需要的信息,从而更快地发现因突变和罕见遗传病等问题。整合ChatGPT的基因测序分析系统可以在处理患者的基因组测序数据后,给出关于基因突变和罕见遗传病的相关。这些信息可以帮助临床医生更快地做出决策,从而提高患者的治疗效果。

基于LLM的AI系统已经被用于学习蛋白质中氨基酸顺序与蛋白结构和功能之间的关系,助力人工设计全新的蛋白质。日前在Nature Biotechnology上发表的一篇论文中,研究人员使用基于大型语言模型设计的ProGen系统,设计出具有和自然溶菌酶活力相似的全新溶菌酶。研究人员表示,这一新技术可能比获得诺贝尔奖的定向进化(directed evolution)蛋白设计技术更有威力,给蛋白工程学领域注入新的活力。

凭借先进的自然语言处理能力,LLM工具可以被编程来跟踪制药业的相关新闻和事件,使利益相关者能够在关键新闻事件发生时立即获知。这种能力使制药公司能够保持对重大市场发展、监管变化和新的科学发现的最新认识。

2. 市场情报

LLM 工具提供的市场情报能力,可以使制药公司能够获得对其行业和竞争对手的宝贵见解。通过寻找和综合各种信息来源的能力,包括内部报告、外部情报和社交媒体活动,使利益相关者能够随时了解行业趋势和关键见解。此外,自然语言处理能力使利益相关者能够提出具体问题,查询庞大的数据集,并收到相关的答案,从而为战略业务决策提供信息。

3. 医学教育

来自麻省总医院和AnsibleHealth的研究人员最近发现,ChatGPT几乎可以通过美国医学执照考试,证明了ChatGPT可能是医学教育领域的一个有用工具,包括作为未来医生和其他医疗保健提供者的研究助手,提供世界上一些最好的医疗保健临床医生的工作。

4. 全天候医疗援助

在传统的基于办公室的亲自医疗护理系统下,下班后看医生的机会可能非常有限且费用高昂,有时会给获得此类医疗服务带来障碍。ChatGPT类工具有可能在这一领域带来巨大的变化,将亲自护理转变为低成本、全天候的人工智能支持的护理。例如,ChatGPT类工具可以帮助慢性病患者,提醒他们需要安排常规筛查,填写处方,协助其他健康事项,如监测步数、心率和睡眠时间,并定制营养计划。

5. 医学相关日常工作

除了研发环节,Nature和The Lancet Digital Health上发表的文章指出,ChatGPT还有一项潜在应用场景,即将科学家和医生从一些重复性劳动中解脱出来,更好地聚焦于科学研究和治疗患者。比如,很多研究人员已经在使用ChatGPT来帮助写作科学论文的背景材料部分,或者用它来辅助对论文的编辑。在医院的环境里,ChatGPT有可能替代医生撰写出院总结等具有标准格式的报告。

AI将有助于将占用不必要时间和人力的日常工作自动化,对于医疗机构来说,ChatGPT可以被训练来简化病人的接收过程,为病人提供常见问题的答案,并汇编病人记录,这将有助于医生有效评估病人需求,提供诊断,并快速确定治疗计划。

LLM工具已来到医学会议上

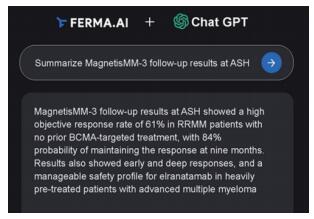

ZoomRx瞄准医疗市场,推出了新应用程序FermaGPT。ZoomRx为4月14日至19日举行的美国癌症研究协会(AACR)年会推出其生成性人工智能产品的公开版本,专门用于医学会议。虽然ZoomRx也为其付费客户创建了定制版本,但新的「轻型」版本公开免费使用。

ZoomRx的高管拒绝透露具体的制药业客户,但其Ferma.ai网站将辉瑞、葛兰素史克、百时美施贵宝和杨森列为「值得信赖的」公司。Ferma.AI是ZoomRx开发的一个LLM,它利用了全面的生命科学数据集、精心设计的知识图谱、制药业专用的训练模型以及专业的人类智能和监督。这种方法使Ferma.AI能够适应制药业的具体需求,其处理和理解复杂的医学和科学语言的独特能力使其有别于传统模型。Ferma.AI有可能通过提供快速、准确的信息,使繁琐的任务自动化,并使数据驱动的决策更容易实现,从而改变制药业的现有工作流程。

FermaGPT的AACR应用程序可以梳理所有8230份提交的摘要和研究,以满足特定的请求,如「识别NSCLC中的新型KRAS摘要」或「总结围绕前列腺癌种族差异的关键讨论」。除了人工智能生成的一两段回答用户的问题外,FermaGPT还能够在下放列出原始材料和链接。作为在第一批AACR摘要发布后推出的第一个「原型」,ZoomRx计划在数据和信息发布后继续添加。ZoomRx计划今年为大多数大型医学会议以及许多小型会议创建FermaGPT公共访问应用程序,包括AAN、ASCO、ESMO、SABCS和ASH。

在制药业应用LLM类工具,也有不少障碍

尽管营销和讨论热度很高,但到目前为止,LLM的应用大多数是在制药业之外,在制药业的应用相对较少,范围也很窄。

虽然ChatGPT所展示的LLM技术的进步有望。虽然ChatGPT所展示的LLM技术的进步有望成倍地扩大应用范围,但必须克服几个关键障碍几个关键的障碍,才有可能在制药业中得到普遍应用。

1.医药数据集不易获得

任何AI算法的有效性,都依赖于具体数据的可用性。没有强大的数据集,AI技术就很难按要求执行。例如,ChatGPT的训练数据集只收集到2021年,如果询问近三年中发生的任何事件,则很难做出回答。

LLM需要数以百万计的不同场景来发现模式、 从经验中学习,并适当地调整自己。然而、由于制药商使用的是专有数据源,往往缺乏互操作性,大多数LLM没有接受过针对生命科学领域的数据集的培训。

LLM工具需要纳入医疗保健的特定数据,包括临床试验、新闻稿、新闻报道、社交媒体活动等等。此外,相关工具也需要能导入、组织特定的专有数据,如市场研究报告、 CRM、数字营销活动等,以定制特定于客户的产出。

2. 患者隐私安全受到挑战

使用ChatGPT也可能是一把双刃剑,特别这在涉及数据安全和患者信息隐私的问题上。类ChatGPT工具在很大程度上依赖于大量在线数据的准确性。作为一个开放的工具,ChatGPT所训练的在线数据点可以被恶意行为者获取,攻击者可以针对这一漏洞发动攻击。欧洲数据保护委员会支持专家库的成员Alexander Hanff警告:「如果OpenAI通过网络抓取获得其训练数据,那就是非法的。」在欧盟,从网站上搜刮数据点有可能违反GDPR以及英国GDPR、ePrivacy指令和欧盟基本权利宪章的规定。

此外,如果系统地采用其与患者进行非结构化的开放式对话,有可能在系统故障时导致严重后果。当病人要求ChatGPT回答一些问题、提供信息或执行任务时,患者会无意中提供其受保护健康信息并将其置于公共领域,这意味着聊天机器人现在可以使用这些信息来进一步训练工具,并被纳入对其他用户提示的回应中。

3. 生命科学术语本身就很复杂

即使有一个强大的数据集,医疗数据本身也是技术性的、不系统的和混乱的。临床研究与临床实践、通用名称与品牌名称、缩写与各种适应症和结果等数据都需要联系起来。LLM需要那些彻底了解生命科学领域及其其组成部分,以及将这些技术数据集转化为可操作的解决方案。

4. 错误答案会带来严重后果

医药行业采用LLM的第三个主要障碍是可用性,以及弥合LLM的能力和用户的期望之间的差距。该技术不仅应该能够理解和回答所有类型的问题,而且还必须以一种方便和容易理解的格式提供准确、相关和合理的结果。

针对少数医学问题的提问,ChatGPT给出的回答从表面上看可能是准确的,但熟悉医学信息的人往往能发现其中的小错误。事实上,ChatGPT的公司OpenAI也公开承认,其模型 「有时会写出听起来合理但不正确或无意义的答案」。

这些问题会导致混乱、沮丧和缺乏信任。因此,由于错误信息可能带来的后果,医疗行业对依赖 「黑匣子」技术进行关键决策感到犹豫。相关产品需要强化训练来塑造LLM的输出,需要有生命科学专家提供持续的人工监督,以确保LLM的反应的准确性和相关性。模型性能需要不断改进,并反馈被纳入其中,以防止重复的错误并加强决策。

结论

LLM在制药行业的发展和应用目前仍处于初级阶段,然而,这项技术在不少应用案例和功能领域的潜力是巨大的。

通过利用全面的生命科学数据集、完整知识图谱、制药业特有的训练模型以及专业的人类智能和监督,也许更加针对医药行业的ChatGPT衍生产品可以改变许多制药业特有的工作流程。

综合编译:John Xie

参考材料:

ChatGPT And Healthcare Privacy Risks - Healthcare Law Blog

Microsoft Launches BioGPT, the ChatGPT of Lifescience - ANALYTICS INDIA MAGAZINE

NVIDIA Highlights AI, Large Language Model Advances in Life Sciences - Bio-IT World

ChatGPT with pharma data debuts for medical meetings, beginning with AACR – Endpoints News

来源:荣格-《国际医药商情》

原创声明:

本站所有原创内容未经允许,禁止任何网站、微信公众号等平台等机构转载、摘抄,否则荣格工业传媒保留追责权利。任何此前未经允许,已经转载本站原创文章的平台,请立即删除相关文章。